SVG Diagramm erzeugen mit Python und C# im Vergleich

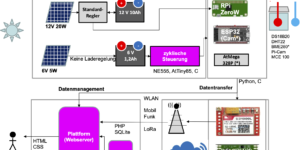

Gerade im IoT-Umfeld nehmen die Datenmengen gerne schwindelerregende Umfänge an. Die einzige Chance, den Überblick zu behalten, ist eine geeignete Datenvisualisierung. Der erste Schritt bei Zeitreihendaten ist die Erstellung einer …